企業の買い手にとっての意味

企業の買い手はTPUそのものを購入するわけではない。パブリッククラウドや、クラウドインフラ上で動くSaaSプラットフォーム、そしてオンプレミスとクラウドにまたがるハイブリッド構成を通じてAIサービスを利用する。では、なぜチップの発表が重要なのか。少なくとも3つの理由がある。

AIインフラのコストは、事業上の重要な意思決定になりつつある

グーグルは、検索やYouTube、Gmail、そして企業向けGeminiサービス全体でTPUによるAI推論を運用している。このインフラの効率性は、AI搭載サービスのコスト構造に直結する。グーグルが優れたハードウェアによって推論コストを下げれば、AIを大規模運用する経済性は、グーグルにとってもクラウド顧客にとっても改善する。証券取引会社のCitadelは、TPUの顧客としてコストを30%削減し、取引システムで2〜4倍の効率改善を達成した例として挙げられた。専用ハードウェアは当初の設計ターゲットをはるかに超えてスケールする。

多くの企業の買い手にとって、AIが最大の価値を生むのは推論

ここ数年、最先端モデルの大規模学習や企業向けAIのファインチューニング(微調整)から、推論へと軸足が移ることが議論されてきた。それがついに現実になり、推論を改善する手段も複数ある。その1つが推論向けに設計された新しいTPUだ。ヴァーダットはウェブ検索を歴史的な類比として引き合いに出し、重い処理は学習で行われる一方、価値が生まれるのは提供(サービング)だと述べた。「サービングこそが、Geminiの企業向け、検索、広告、YouTubeにおいて価値が生まれる場所である」。企業のAI予算とインフラのロードマップは、価値が実際に生み出される場所に見合う形で推論インフラを評価しなければならない。

大規模運用における信頼性は、なお未解決の問題であり、しかも重要

ヴァーダットは業界があまり表に出さない課題を率直に認めた。数万個のチップが協調して動く規模では、少なくとも1つのチップが日に何度も故障する。故障の検知と復旧に人の介入が必要なら、最短の対応時間でも30分かかり、その間に進行は完全に止まってしまう。グーグルのアプローチは、97%超の良好な計算スループットを実現し、故障を自動で検知・修復できるようにする。それでもGoogle Cloudは、企業は「故障があること」自体に関心がないと述べた。AIインフラ提供者を評価する企業にとって、スケール時の信頼性と可観測性は、あればよいものではなく、必須要件になっている。

エージェント型インフラへの転換は、すでに始まっている

ヴァーダットの発言で意外に先を見据えていたのは、CPUに関する予測だ。エージェント型システムが成長するほど、汎用コンピュートが復権するという。専用チップを置き換えるのではなく、それらをオーケストレーションするためである。エージェントは、サンドボックス化された環境、仮想マシン、コード実行、そして推論呼び出しをまたぐ動的ルーティングを必要とする。彼はそれがCPUの仕事だと述べた。

企業のインフラ計画担当者は注意すべきだ。エージェント型AIは推論だけの問題ではない。専用アクセラレーター、汎用コンピュート、ネットワークトポロジー、そしてハードウェアの上位に位置するアイデンティティやガバナンス層までを含む、システム設計の問題である。グーグルが、現在TPU上で稼働している例として挙げた企業群(自社の消費者向けサービスから金融サービス企業まで)は、すでにインフラを全体として捉えている。

企業がいま下すインフラの意思決定は、エージェント型システムをどれだけ迅速に、どれだけ費用対効果高く、スケールさせて展開できるかを左右する。レイテンシー、信頼性、専門特化を前提に設計されたプラットフォームの上に構築することは、そうではないプラットフォームの上に構築することとは、出発点が異なる。

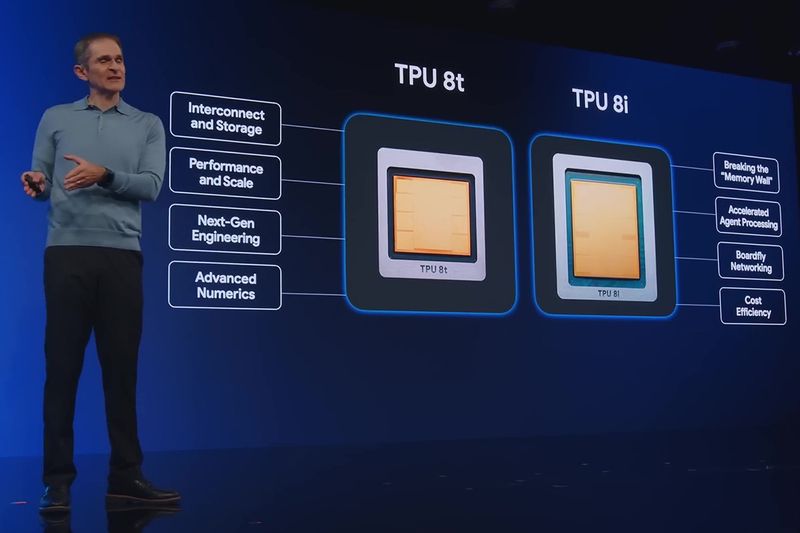

Google Cloudの第8世代TPUは、AIインフラの進化がまだ終わっていないことを示すシグナルである。