ジャド・ブーセルハムはテック起業家であり、Verdexの共同創業者である。

日々の業務の中で、私はモデルの性能最適化に数えきれないほどの時間を費やしてきたが、ある厳しい現実に直面することになった。2026年、AI普及の主な障壁は変化している。生の知能は依然として重要だが、推論(インファレンス)にかかる限界費用の上昇、つまり生成されるすべての出力に伴う継続的なコストが、AIインフラ領域における重大なボトルネックとして浮上しているのだ。

長年にわたり業界は、巨大な中央集権型クラウドクラスタに支えられた「何があっても成長」志向で動いてきた。だが、単純なチャットボットから複雑なエージェント型ワークフローへと移行するにつれ、採算の計算が崩れ始めている。推論とは、学習済みモデルが実際に出力を生成する段階であり、今や企業コストを左右する数十億ドル規模のエンジンになった。デロイトは最近、2026年における推論ワークロードがAI計算資源全体の約3分の2を占めると推計した。これは2023年の3分の1から増加している。

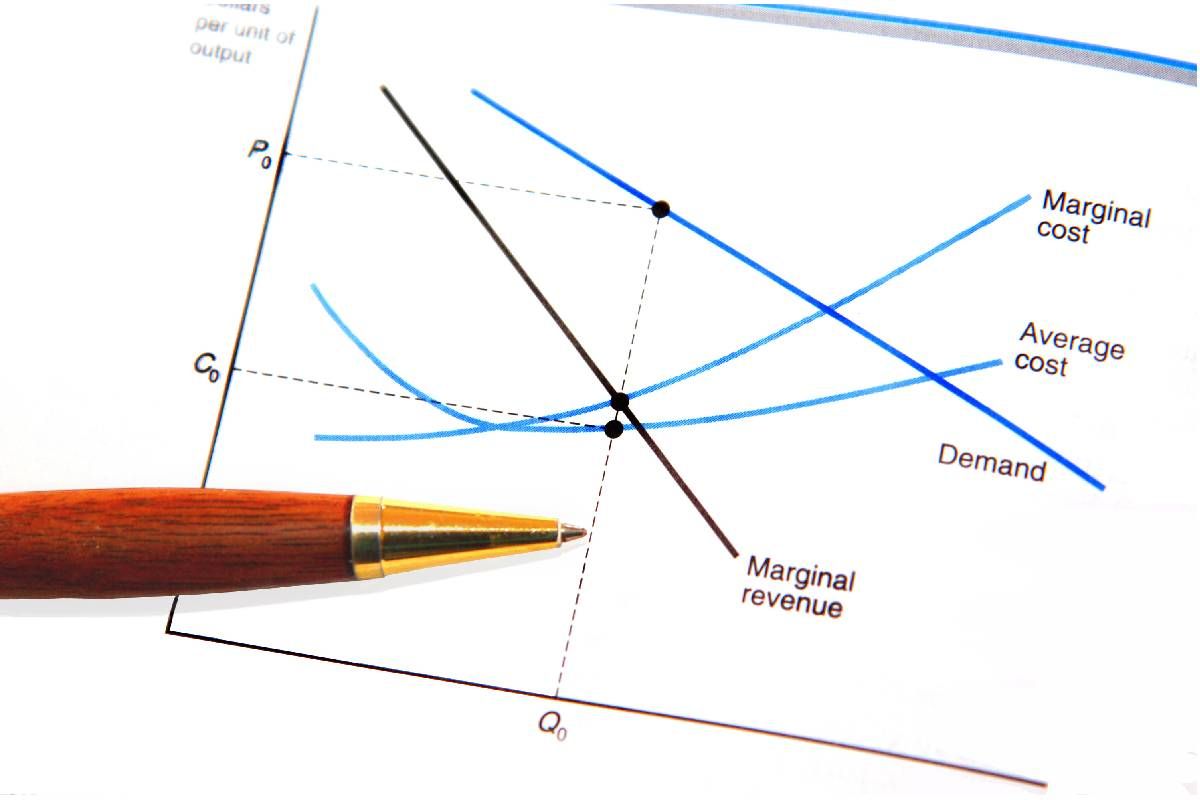

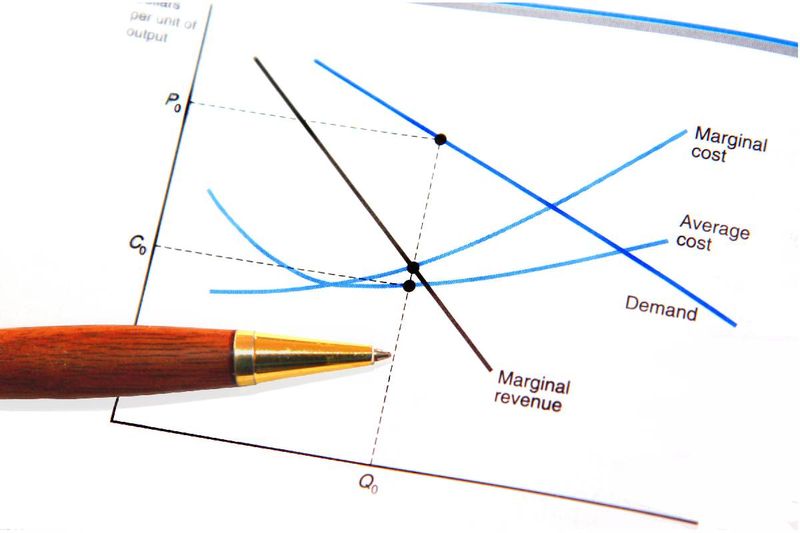

この変化は、企業にとってユニットエコノミクスの危機を生み出している。ユーザーとのやり取り1回あたりのコストがクラウドGPU上で1セントの何分の1かにすぎないとしても、数百万人規模にスケールさせることは技術的な課題というよりも財務的な課題となる。力任せのクラウド推論に依存し続ければ、生成の限界費用の高騰が、本来それによって駆動されるはずのイノベーションを抑え込むことになる。

エッジ・クラウドのハイブリッドアーキテクチャの台頭

単にモデルサイズを拡大する潮流を超えて、AIラボはより洗練されたアーキテクチャの開発を優先しつつある。エッジ・クラウドのハイブリッドシステムへ向かう本質的な転換が起きている。

理屈は単純だ。パラメータ数が1兆を超える巨大なクラウドモデルに、単なる「Hello」や基本的なデータ入力タスクを送る必要があるのか。蒸留された70億パラメータのモデルなら、コストを10分の1に抑えてローカルで処理できる。スマートフォンやPCに搭載される最新のニューラルプロセッシングユニット(NPU)はいまや標準となり、消費電力2.5ワットで毎秒10兆回の演算を実現している。

これにより「動的ルーティング」が可能になる。これは「コントローラー」モデルがプロンプトの複雑性を評価し、どこで処理するかを判断する技術である。

• エッジ:低レイテンシ、プライバシー重視、または定型的なタスクに適している。

• クラウド:高度な推論や複雑な問題解決に通常使用される。

このハイブリッド手法はすでに成果を上げている。初期の事例研究では、データをローカルで処理することで、クラウドへのデータ転送と推論コストを約60%削減しているという。

効率化のエンジニアリング:蒸留と量子化

エッジコンピューティングを成立させるために、分野全体は根本的な性能を損なわずにモデルサイズを削減することに注力してきた。これは主に2つの技術的柱、モデル蒸留と量子化によって実現される。

• 蒸留:教師と生徒の関係と考えるとよい。巨大な「教師」モデル(GPT-5など)が、より小さな「生徒」モデル(15億パラメータのQwenバリアントなど)を訓練する。生徒は教師の推論を模倣することを学ぶが、必要なパラメータは一部にとどまる。

• 量子化:モデル内部の数値(重み)の精度を下げる手法である。16ビットから4ビット精度へ移行することで、精度の低下をほとんど伴わずに大幅なメモリ圧縮を実現できる。

私の経験では、特化型の蒸留モデルは特定のタスクにおいて汎用の巨大モデルをしばしば上回る。こうしたスリムなモデルは、特定の目的に無関係な一般知識に由来する余計な計算オーバーヘッドを抱えないため、より効率的に動作する。

主権がもたらす優位性

即時の財務的軽減に加えて、データ主権の問題が深刻化している。2026年、データプライバシーはベストプラクティスから厳格な法的義務へと移行した。「機密コンピューティング」市場は今年、540億ドルに達すると予測されている。その背景の一部には、専有データをサードパーティのクラウド環境へ送信することが、企業にとって最大の競争優位を損ない得るという認識がある。

信頼実行環境(TEE)などのハードウェアレベルの分離を活用し、オンプレミスまたはエッジで推論を実行することで、組織は最先端レベルの知能の恩恵を享受しながら、競争力の源泉となるデータ資産を保護できる。業界の最近の推計によれば、2026年には企業のAIワークロードの70%以上が機密性の高いデータを含み、ローカルで主権を確保したインフラはAI経済への参加要件になりつつある。

推論スプロールの落とし穴

アーキテクチャの効率化へ向かう道のりには、技術的リスクが付きまとう。現在の状況で最も重大な脅威は「推論スプロール」だと私は考える。これは、最適化されていない多段のエージェント型システムが再帰的なトークンループに入り込む現象である。こうしたサイクルは、見合う投資対効果を生まないまま、膨大な計算予算を消費する。

ガートナーは最近、2027年末までにエージェント型AIの取り組みの40%以上が中止されるという厳しい予測を発表した。プロジェクト中止の主要因として、コストの増大と不十分なリスク管理を具体的に挙げている。

さらに業界は、物理的な上限にも直面している。国際エネルギー機関(IEA)は、データセンター、AI、暗号資産に起因する世界の電力需要が2026年後半までに倍増する可能性があると予測している。地域によっては、データセンターが総電力供給能力の約半分を消費する状況も見られる。ローカルNPUハードウェアを活用するエッジ最適化・省電力モデルへと舵を切らなければ、エージェント時代が十分に成熟する前に、業界が送電網容量を超過するリスクがある。

結論:ユニットエコノミクスを最優先せよ

白紙小切手の計算予算という時代は終わった。2020年代半ばの際限ない熱狂は、ついに2026年の構造的・インフラ的制約と衝突している。競争力を維持するために、スタートアップも既存の大企業も、力任せの計算から離れ、「推論の経済性」という考え方を採用できる。

この環境で成功するには、従来型のソフトウェア開発から脱し、アーキテクチャの効率性に特化した集中が必要だ。モデル蒸留、ハイブリッドルーティング、ハードウェアレベルのプライバシーを統合することで、AIを高価で中央集権的なぜいたく品から、信頼できる普遍的な公共インフラへと変えられる。計算コストが依然として大きな障壁であることに変わりはないが、こうした制約を工学的に回避する者こそが、この時代の経済的潜在力を最大限に解き放つ存在となり得る。