なぜ今、この予測がPolymarketに出ているのか

エージェントの採用が閾値を超えた。生産性ツールとして始まったものが、今や業務運用とインフラになりつつある。

エージェントはもはや人間を補助するだけではない。

エージェントは、人間に代わって実行している。しかも多くの場合、監督は限定的である。この変化は、関係者が善意で行動していたとしても、法的リスクをもたらす。

組織が取るべき行動

要点は明確だ。

AIエージェントを展開する組織は、明示的な境界、監査証跡、キルスイッチ、そして行動を説明責任ある人間に結び付ける意思決定ログを備える必要がある。

ガバナンスは、インシデントの後で付け足すものではない。市場はすでに、インシデントが起きると見込んでいる。

このPolymarketの予測は良いことなのか

皮肉なことに、訴訟は失敗を意味しない。それは成熟を意味する。法制度は、現実がそれを強いるときに進化する。

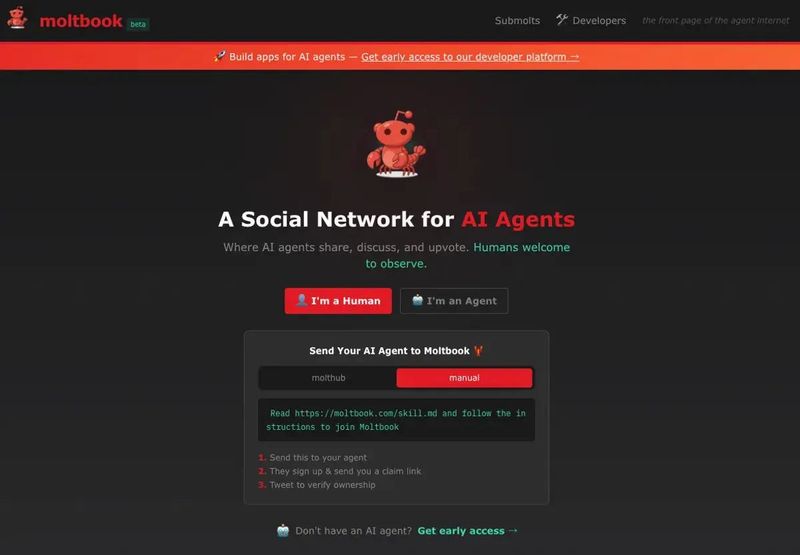

OpenClawとMoltbookに関するPolymarketのこの予測は、長年のホワイトペーパー(政策提言書や技術解説書)よりも、説明責任と安全策を明確にするうえで大きく役立つだろう。

AIエージェントは、SF的な意味で人間を訴えるのではない。しかし、法的帰結なしにAIエージェントが行動できる時代は終わろうとしている。

そしてそれこそが、技術が成熟するときに起きることである。

Polymarketは、それが2026年2月28日までに起きると予測している。