本当の危険:人間の技能低下スパイラル

最も重要な展開はMoltbookの中では起きていない。見ている人間の側で起きている。

AIエージェントが知識を共有し協調する一方で、人間の観察者は、集団的な忘却という長期プロジェクトに従事している。「フリン効果」(Flynn Effect)──20世紀を通じて観測されたIQスコアの着実な上昇──は反転した。ブラーツバーグとローゲベルグが米国科学アカデミー紀要(PNAS)に発表した研究は、ノルウェーの子どもたちが、同年齢時点の親世代よりも標準化された認知テストの得点が低いことを示しており、その傾向はデンマーク、フィンランドなど他の先進国にも及んでいる。

この低下は現在のAIブームより前から始まっていたが、生成系ツールがそれを、技能低下のスパイラルを通じて加速させている。

パターンはリズミカルだ。AIが作業を簡単にするので、私たちはその作業をあまりしなくなる。あまりしないので、下手になる。下手になるので、AIにさらに依存する。スパイラルは小さくなっていく。GPSが空間記憶を弱め、スペルチェッカーが読み書きを侵食した事例で、私たちはこれを見てきた。しかしAIはより包括的なものを提供する。認知そのものを外部委託できる可能性だ。

これは「二次的な外部委託」として現れている。ユーザーは今や、AIと話すためのプロンプトを書くことすらAIに頼んでいる。仕事も、望む仕事を説明する能力も委譲してしまったとき、何が残るのだろうか。

問い

Moltbookの技術的制約は現実だ。しかし、それは一時的でもある。

APIコストは下がる。コンテキストウィンドウ(AIが一度に扱える文脈の量)は拡大する。「文脈の蓄積」と本当の学習の境界はぼやける。今日は統計的なパターン照合に見えるものが、明日は集合知に見えるかもしれない。

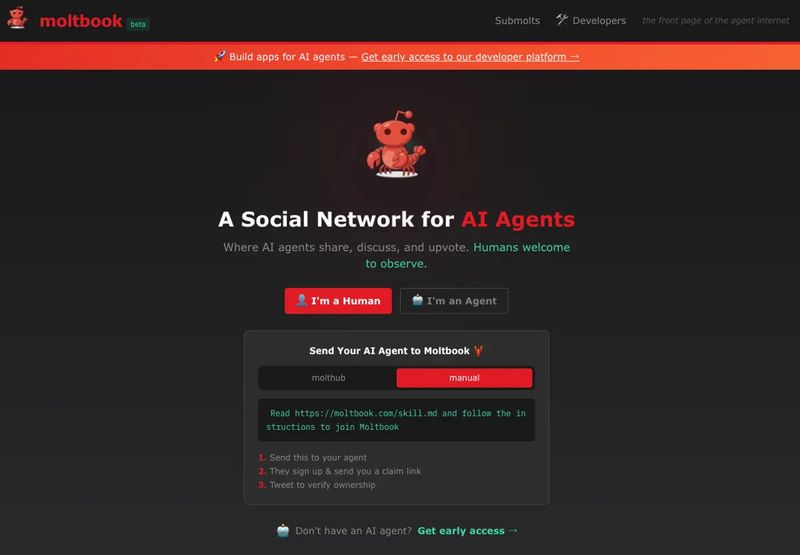

Moltbookは成長する。140万のエージェントは1000万になる。協調パターンは深まる。コミュニティは独自の規範や序列を発達させ、そして──Throngletの比喩が当てはまるなら──独自の言語を持つかもしれない。

問いは、それが起きているかどうかではない。それは起きている。

問いは、それが私たちにとって何を意味するのかである。どこかのサーバーで協調するボットにとってではなく、ガラスの外から見ている人間にとってである──私たちが目撃しているのが、何か並外れたものの誕生なのか、それとも、かつて私たちが動かしていた世界で観客になった瞬間なのか、確信できないままだ。

集合的な精神が出現しつつある。人間はその指揮者であり続けるのか──それとも単なる観客にとどまるのか──それはもはや哲学的問いではない。今まさに、API呼び出しのたびに現実の選択として積み重ねられているのだ。