AirPodsのライブ翻訳については、9月にアップルが発売したワイヤレスヘッドホン「AirPods Pro 3」のプロダクトレビューと一緒に、その使用方法の概略をレポートしている。こちらも合わせて参照してほしい。

アップル独自のAIモデルを多言語翻訳に活用するサービスは、ライブ翻訳が登場する以前からアップルの各OSやアプリにも段階的に採用されてきた。Safariが搭載するウェブページの翻訳機能がその一例に挙げられる。

新しいライブ翻訳はその発展型だ。ホァン氏は「Safariの翻訳機能は長文の読解を想定したものです。日常会話のように短いフレーズで交わされるやり取りのために、私たちはまったく新しい機械学習モデルを構築し、ライブ翻訳のために最適化した」ものであるという。

MacやiPadでも使えるメッセージや電話のライブ翻訳

ユーザーがアップルのライブ翻訳を活用する方法には、大きく分けて2通りのアプローチがある。ひとつはアップル純正のコミュニケーションアプリで活用する方法。そしてもうひとつが「AirPodsのライブ翻訳」だ。まず前者から説明する。

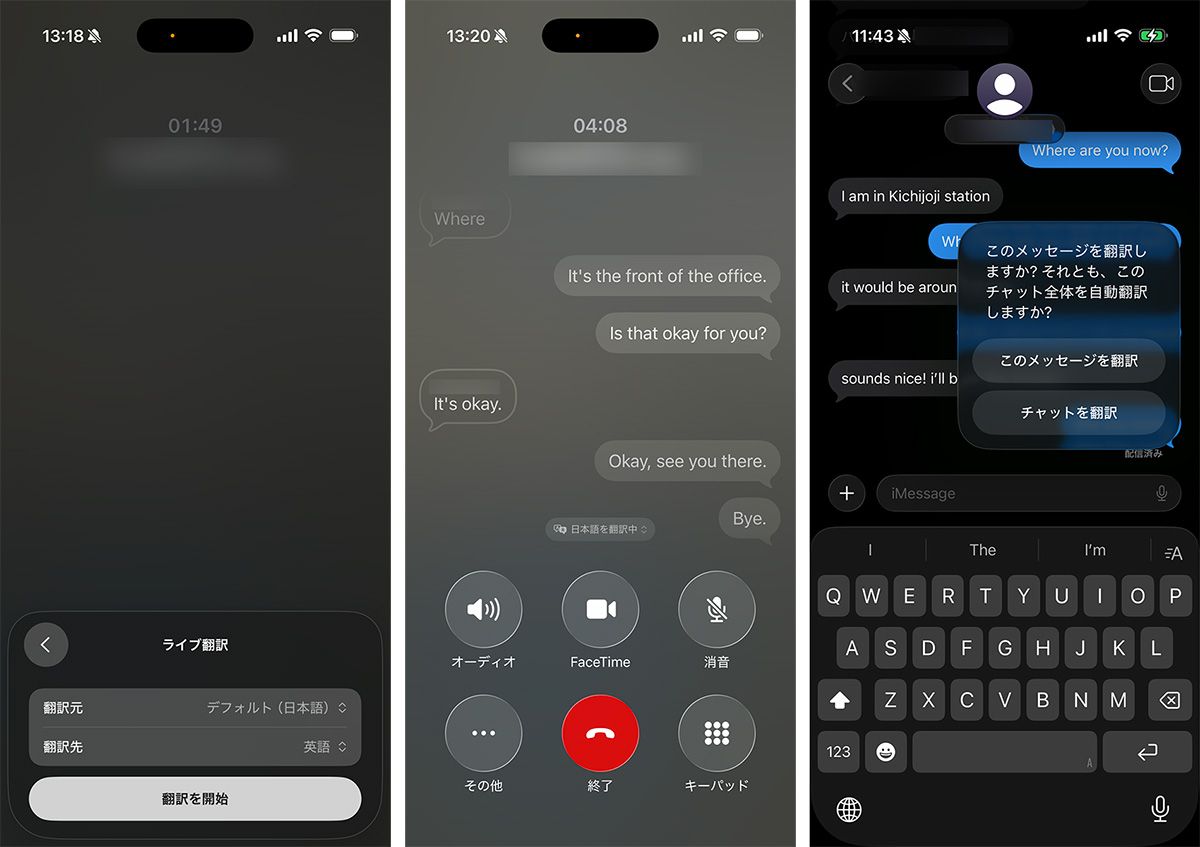

ライブ翻訳はiOS 26、iPadOS 26とmacOS 26 TahoeのメッセージとFaceTime、電話のアプリに統合されている。watchOS 26もメッセージアプリでライブ翻訳が使える。

メッセージアプリでは、ライブ翻訳がテキストを自動的に翻訳する。相手と1対1のメッセージや、グループチャットにも対応しており、ユーザーがキーボードでタイピングを始めるとすぐに翻訳先の言語にテキストが変換されて、送信前に内容を確認できる。