AI研究のスタンス

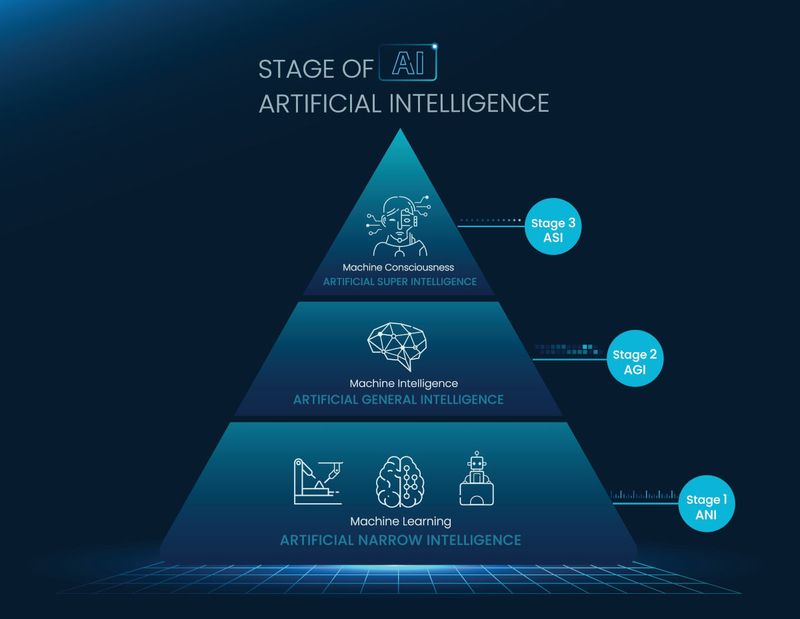

AI研究者は、人間の知性には最大レベルが存在するに違いないという立場をとることが多い。たとえ証明できなくても、最大値が存在することを彼らは一般的に受け入れている。まったく未知ではあるが、もっともらしく存在すると考えられるその限界が、AGIとASIの分水嶺となる。AIが人間の知性の限界を超えたとき、私たちは超人的な領域に足を踏み入れることになる。

『An Approach to Technical AGI Safety and Security』と題された最近の論文(著者:グーグル・ディープマインド所属のロヒン・シャー、アレックス・アーパン、アレクサンダー・マット・ターナー、アンナ・ワン、アーサー・コンミー、デイビッド・リンドナー、ジョナ・ブラウン=コーエン、ルイス・ホー、ニール・ナンダ、ラルーカ・エイダ・ポパ、リシャブ・ジェイン、ローリー・グレイグ、サミュエル・アルバニー、スコット・エモンズ、セバスチャン・ファーカー、セバスチャン・クリエ、セントゥーラン・ラジャマノハラン、ソフィー・ブリジャーズ、トビ・イジトエ、トム・エヴァリット、ヴィクトリア・クラコフナ、ヴィクラント・ヴァルマ、ウラジミール・ミクリク、ザカリー・ケントン、デイブ・オア、シェーン・レッグ、ノア・グッドマン、アラン・ダフォー、フォー・フリン、アンカ・ドラガン、論文公開サイト:arXiv、2025年4月2日)の中で、彼らは以下の重要な指摘を行っている(抜粋)。

・人間の知能が上限とはならないという仮説:AIの能力は、最も有能な人間と同等レベルに達した後も、進歩を止めないだろう

・私たちの第一の主張は、すでに超人的なパフォーマンスがいくつかのタスクで説得力ある形で実証されているということだ。これは、人間の能力がAIにとって意味のある上限とはならない、具体的かつ明確に定義されたタスクが存在するという「概念実証」を提供する

・私たちの第二の主張は、AI開発がより汎用的で柔軟なシステムへの傾向を示しているということである。その結果、将来的にはますます多くのタスクで超人的な能力が出現すると私たちは予測している

・私たちの第三の主張は、単純に、AIの能力が最も有能な人間と同等レベルに達した時点で改善が止まるという原理的な論拠は観察されていない、ということである

これらの要点から、研究者たちが超人的知性のようなものが存在するという説得力のある論証を試みていることが分かる。超人的とは、人間の知能上限を超えるものを指す。さらに、AIは人間の知能上限で行き詰まることはない。AIは人間の上限を凌駕し、超人的知性の領域へと進んでいくのである。