それによると、自身の一部の業務がAIに取って代わられるかの問いに、「非常にそう思う」「ややそう思う」合わせて59%の人が「思う」と回答。また、AIがセキュリティ専門家の業務効率を向上させるかの問いには、「非常にそう思う」「ややそう思う」合わせて90%の人が「思う」と回答している。

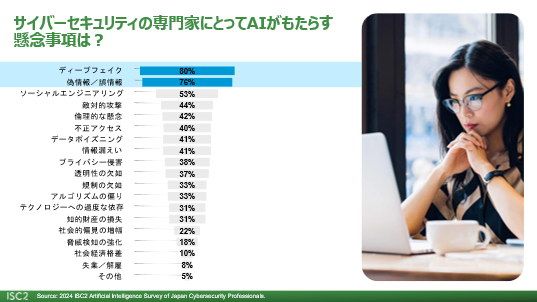

続いて、AIがサイバー攻撃やその他の悪意のある活動に利用されることについて、「非常に懸念している」「中程度の懸念がある」合わせて75%の人が「ある」と回答。懸念事項としては、「ディープフェイク」が80%でもっとも高く、「偽情報/誤情報」が76%、「ソーシャルエンジニアリング」が53%と続いている。この結果は、グローバル調査でも同様だ。

ただ、セキュリティの専門家はサイバー犯罪者よりもAIの進歩から多くの恩恵を受けるかの問いに、「非常にそう思う」「ややそう思う」合わせて44%の人が「思う」と回答。これは、グローバルの調査結果より28ポイントも上回っており、日本のほうが若干楽観的な見方をしているようだ。

一方、日本の企業・組織が自社におけるAI規制についてどのように取り組んでいるのかの調査によると、所属する企業や組織では、どのようにAIの使用を規制しているのかとの質問に、AIの安全かつ倫理的な使用に関しては、方針を協議中が31%。AIの安全と導入に関する方針も34%が協議中とのこと。まだまだ方針が定まっていない企業のほうが多い。

また、生成AIツールへのアクセスについては、24%の企業・組織が「従業員がすべての生成AIツールにアクセスできる」のに対し、64%の企業・組織が「従業員が一部の生成AIツールにアクセスできないようにしている」とした。同様のグローバル調査では、前者が29%、後者が32%となっており、日本はまだ生成AIに対して開放的ではないことがわかる。

このように、従業員が生成AIを使いたいとしても、日本ではまだ思うように利用できない企業・組織が多く存在している。サイバーセキュリティ専門家の見解にしても、企業・組織の生成AIに対する取り組みにしても、日本とグローバルでは考え方やスピード感の違いが浮き彫りになっている。広い視野を持って生成AIの波に乗り遅れないようにしたいところだ。

出典:ISC2「日本のサイバーセキュリティ専門家を対象にした生成AI時代のサイバーセキュリティ調査」より